もうひとつのアシスタント

うわさのローカルLLM(大規模言語モデル)、Gemma 4をちょっとだけ試してみました。4月2日リリースのできたてくん、読みはゲンマではなくジェンマということで、どことなく双子座の意思を感じますね。

みんな大好きチャッピーさん(ChatGPT)や悪の副操縦士さん(Copilot)のようなアシスタントがローカル環境で動いてくれるというもので、ローカル環境ならではのネットワーク依存の少なさ、セキュリティの高さ、カスタマイズのしやすさが持ち味だったりします。電波が通らない雲の上や雪山の中でも、ノートPCにこういうのを入れておけばアシスタントとホットな会話や情報交換を楽しむことができるという夢のある話なのです。

Ollamaのインストール

きっとめんどくさいんでしょ?と思ったら、思ったよりもだいぶ簡単でした。

まずローカルLLMの実行環境、Ollama(オーラマ)のページからインストーラーをダウンロードします。

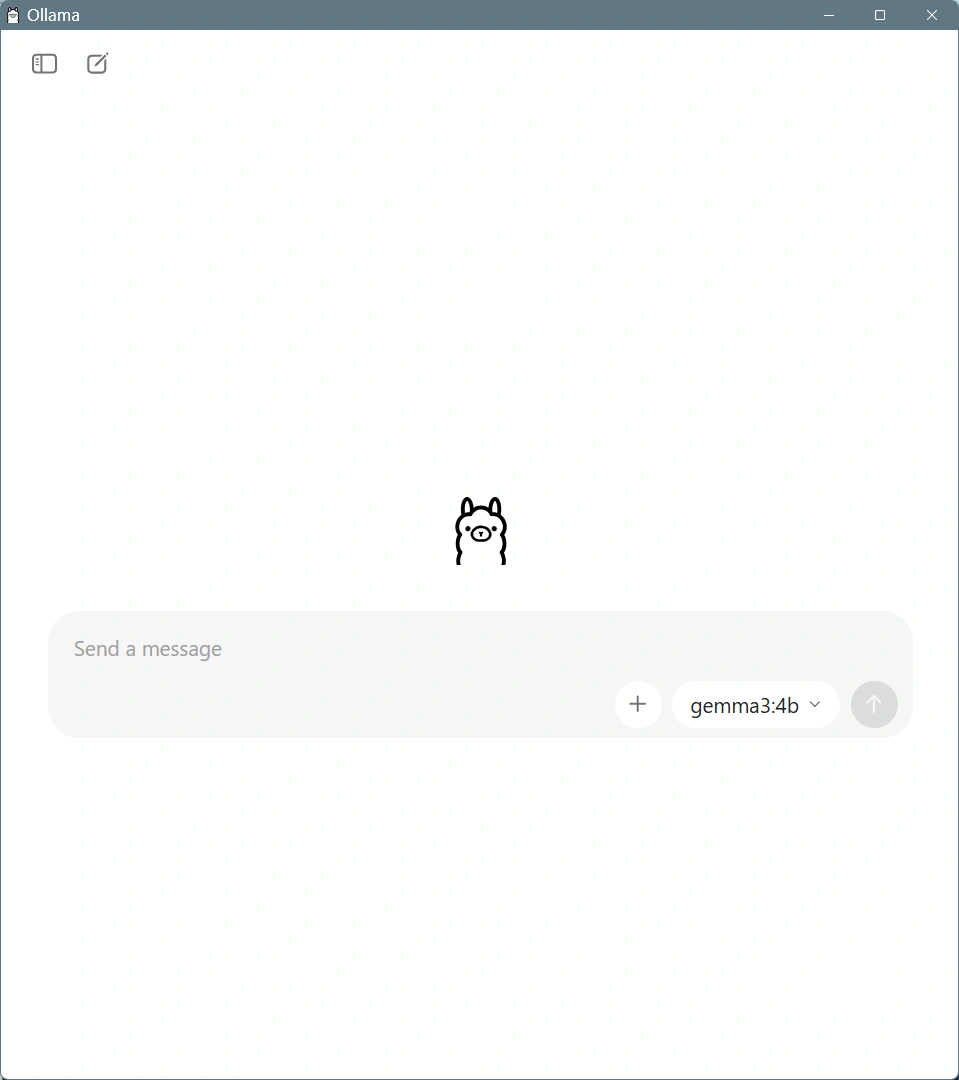

インストールが終わるとこんな画面が立ち上がります。

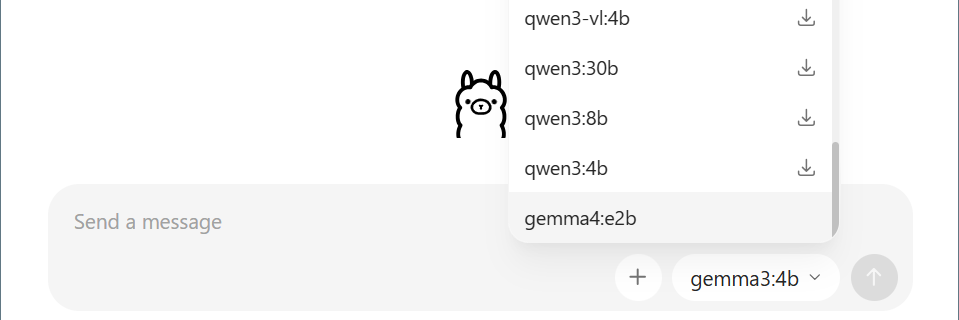

リャマでしょうか。かわいいですね。

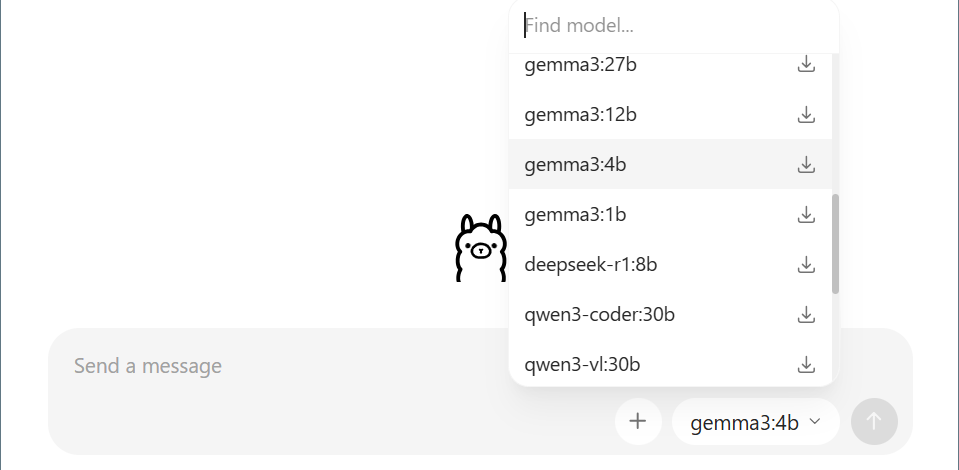

このままgemma3:4bなど、好きなLLMを選んでメッセージを送るとダウンロードが始まり、使えるようになります。

bはbillion(10億)の頭文字で、4b、12b、27bと数字が多くなるほど性能は良くなるけど動作は重くなるくらいに思っておいていいでしょう。40億、120億、270億…そのくらいお金があったら幸せに暮らせるんだろうなー。

しかしこのリスト、現時点では最新版のGemma 4はありません。ダウンロードできるのは1世代前のGemma 3までです。そのうち普通にダウンロードできるようになるんでしょうけど、せっかちなので例の黒画面によるインストールを試してみました。

Gemma 4のインストール

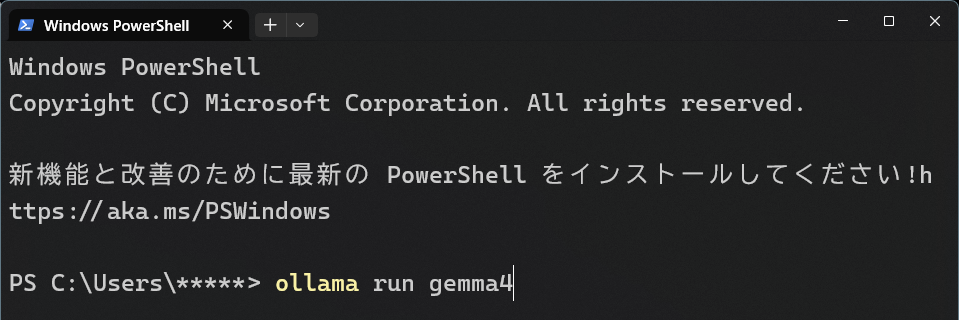

例の黒画面ことWindows PowerShellを出して下のコマンドを打ち込みましょう。コピーペーストしたい人は下の文字をコピーして右クリックでもいけるはずです。

ollama run gemma4

特に指定がない場合は4b版になるようです。軽量版がいい人はこっちで。

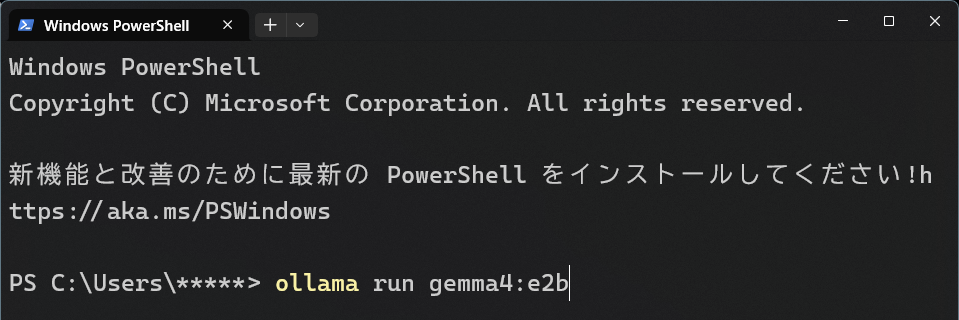

ollama run gemma4:e2b

Enterキーを押して実行した後、ダウンロードが始まります。

ダウンロードが終わったらデスクトップ版のOllamaを立ち上げ直すと下の方にインストールしたGemma 4が表示されているはずです。

あとはもう、いつも通り好きなことを聞いてみるだけですね。

ゆったりと考えて、ゆったりと答えてくれます。

終わるときはタスクバーのかわいいアイコンを右クリックからQuit Ollamaで終わらせて、占有していたメモリを解放するのを忘れないようにしましょう。

黒画面上で遊びたい人はWindows PowerShellで

通常版は ollama run gemma4

軽量版は ollama run gemma4:e2b

と入力すると動いてくれます。終了はexitではなく/byeでね。こうして遊んでみると少しは黒画面と仲良くなれるのかもよ。

インストールの確認と消去

やっぱり他のにしたい、消したいという場合はWindows PowerShellで

ollama list

と入れて実行するとインストールしているLLMの一覧を出すことができます。そして一覧から名前を確認した上で

通常版は ollama rm gemma4

軽量版は ollama rm gemma4:e2b

と入力して実行することで消せます。

消せたかどうかを確認したい場合はもう一度

ollama list

を入力して実行しましょう。

初期設定ではC:\Users\(ユーザー名)\.ollama\models\blobs の中に入るようなので、心配な人は確認しながらやってみるといいかもしれません。

まとめ

意外と簡単…しかも本当にローカルで動いてる…。

ローカルLLMというのは夢のある話であると同時にスペックを要求するものでもあり、巨大なデータセンターではない普通のノートPCではゆったりな動作になるのは仕方ない話だとは思っていましたが、予想外に快適で驚いています。

文章でのやりとり以外は画像を読み込めるくらいで、画像を出したり動画を出したりはできません。そこは巨大なデータセンターをバックに日々進化するオンラインアシスタントの優れたところなのは確実でしょう。しかしネットワークに依存せず手元の環境で動いてくれる安心感はありがたいもので、どのくらいできるものなのか、そしてどのくらいカスタマイズできるものなのか…これからじっくり試してみたいです。

そうそう、Androidではこういうので試すことができるみたいですよ。

ローカルLLMだからって「お前を消す方法」とか聞いたらダメなんだからなー。